昆仑万维SkyReels团队近日宣布了一项重大技术突破,他们成功推出了SkyReels-V2,这是一款全球领先的使用扩散强迫框架的无限时长电影生成模型。该模型结合了多模态大语言模型、多阶段预训练、强化学习和扩散强迫框架,实现了技术上的协同优化。

在过去的一年里,视频生成技术在扩散模型和自回归框架的推动下取得了显著进展。然而,这些技术仍面临诸多挑战,如提示词遵循能力不足、视觉质量不稳定、运动动态效果欠佳以及视频时长受限等问题。特别是在生成长视频时,现有技术往往需要在高分辨率和视频时长之间做出妥协,且由于通用多模态大语言模型无法解读电影语法,导致镜头感知生成能力不足。

为了克服这些难题,SkyReels-V2应运而生。它不仅在技术上实现了重大突破,还提供了多种实用的应用场景。通过结合多项创新技术,SkyReels-V2已经能够生成30秒至40秒的高运动质量、高一致性、高保真视频。

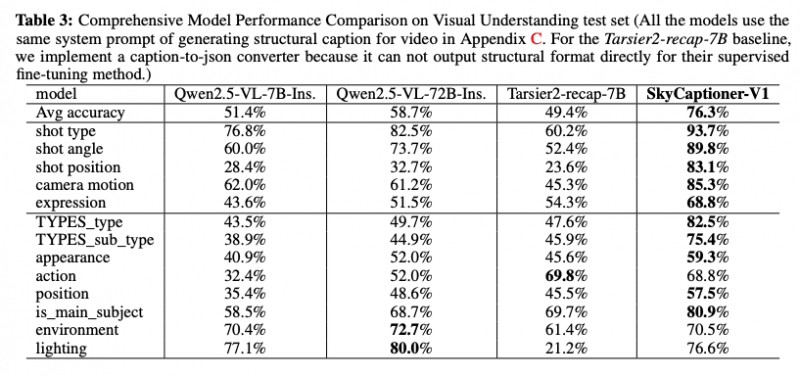

其中,SkyReels-V2的核心技术创新之一是其全面的影视级视频理解模型SkyCaptioner-V1。该模型采用结构化的视频表示方法,将多模态大语言模型的一般描述与子专家模型的详细镜头语言相结合,从而提高了对视频内容的理解能力。通过人工标注和模型训练,SkyCaptioner-V1不仅能够理解视频的一般内容,还能捕捉到电影场景中的专业镜头语言,显著提高了生成视频的提示词遵循能力。

SkyReels-V2还针对运动的偏好进行了优化。通过强化学习训练和使用人工标注的合成失真数据,模型解决了动态扭曲和不合理等问题,从而生成了流畅且逼真的视频内容。为了降低数据标注成本,团队还设计了一个半自动数据收集管道,高效地生成了偏好对比数据对。

在实现长视频生成方面,SkyReels-V2提出了一种高效的扩散强迫框架。与传统的从零开始训练扩散强迫模型不同,SkyReels-V2通过微调预训练的扩散模型,将其转化为扩散强迫模型。这种方法不仅减少了训练成本,还显著提高了生成效率。通过采用非递减噪声时间表,模型将连续帧的去噪时间表搜索空间大幅降低,从而实现了长视频的高效生成。

为了开发一个专业的影视生成模型,SkyReels-V2采用了多阶段质量保证框架。该框架整合了来自通用数据集、自收集媒体和艺术资源库的数据,确保了模型在资源有限的情况下仍能稳步提升表现。通过渐进式分辨率预训练和四阶段的后续训练增强,模型在指令遵循、运动质量、一致性和视觉质量等方面均取得了显著进展。

为了全面评估SkyReels-V2的性能,团队构建了SkyReels-Bench用于人类评估,并利用开源的V-Bench进行自动化评估。在SkyReels-Bench评估中,SkyReels-V2在指令遵循、运动质量、一致性和视觉质量等方面均优于基线方法。在VBench1.0自动化评估中,SkyReels-V2也取得了总分和质量分的最高分,进一步验证了其在生成高保真、指令对齐的视频内容方面的强大能力。

SkyReels-V2的推出为多个实际应用场景提供了强大的支持。在故事生成方面,模型能够生成理论上无限时长的视频,并通过滑动窗口方法和稳定化技术保持连贯叙事。在图像到视频合成方面,SkyReels-V2提供了两种生成方法,并均优于其他开源模型。模型在摄像导演功能和元素到视频生成方面也表现出色,为电影制作、广告创作、短剧、音乐视频和虚拟电商内容创作等应用提供了有力支持。

昆仑万维SkyReels团队表示,他们将继续致力于推动视频生成技术的发展,并将SkyCaptioner-V1和SkyReels-V2系列模型进行完全开源,以促进学术界和工业界的进一步研究和应用。这一举措将为内容创作者提供强大的工具,开启利用AI进行视频叙事和创意表达的无限可能。